نکات کلیدی

-

مدلهای زبانی کوچک (SLMs) امکان انجام استنتاج هوش مصنوعی را در لبه فراهم میکنند، بدون اینکه دستگاههای دارای محدودیت منابع را از پا بیندازند.

-

از SLMها میتوان برای یادگیری و سازگاری با الگوها در زمان واقعی استفاده کرد؛ این کار بار محاسباتی را کاهش میدهد و دستگاههای لبه را هوشمندتر میکند.

-

تکنیکهایی مانند کمّیسازی و هرسکردن باعث میشوند مدلهای زبانی سریعتر و سبکتر شوند.

-

Google Edge TPU برای انجام استنتاجهای هوش مصنوعی با بازدهی بالا مستقیماً روی دستگاههای لبهای طراحی شده است؛ این یک مطالعهی موردی خوب است تا ببینیم تکنیکهای هرسکردن و تنُکسازی چگونه میتوانند مدیریت منابع را بهینه کنند.

-

مسیر آیندهی SLMها برای مدیریت منابع شامل شبکههای حسگر IoT، دستگاههای خانهی هوشمند، دروازههای لبهای در اتوماسیون صنعتی، و دستگاههای سلامت هوشمند است.

در دنیای بیشازحد متصل امروز، جایی که همهچیز از یخچال شما تا دستبند پایش سلامتیتان برای گرفتن سهمی از «کیک پهنای باند» رقابت میکنند، رایانش لبهای قهرمانِ بیسروصدایی است که باعث میشود همهچیز روان کار کند. آن را مثل بچهباحالِ محله تصور کنید که دادهها را همانجایی پردازش میکند که تولید شدهاند، نه اینکه همهچیز را به زور به ابر بکشاند. نتیجه یعنی تصمیمگیری سریعتر، کمتر بلعیدن پهنای باند، و یک تقویت کوچک اما خوشایند برای حریم خصوصی؛ عالی برای همهچیز، از کارخانههای هوشمند تا ترموستات هوشمند شما.

اما یک گیر مهم وجود دارد: دستگاههای لبهای معمولاً از نظر توان پردازشی، حافظه و مصرف انرژی تحت محدودیتهای سختگیرانه کار میکنند. اینجا مدلهای زبانی کوچک (SLMs) وارد میشوند؛ همکار کارآمدی که قرار است روز را نجات بدهد. این مدلهای چابک میتوانند استنتاج هوش مصنوعی را به لبه بیاورند، بدون اینکه دستگاههای دارای محدودیت منابع را زیر فشار له کنند.

در این مقاله، بررسی میکنیم که SLMها چگونه با یادگیری و سازگاری با الگوها در زمان واقعی، کاهش بار محاسباتی و باهوشتر کردن دستگاههای لبه، بدون اینکه چیز زیادی در عوض بخواهند، «جادو» میکنند.

چالشها در محیطهای لبهای دارای محدودیت منابع

دستگاههای رایانش لبهای مثل حسگرهای IoT و ابزارهای هوشمند، معمولاً توانمندی سختافزاری محدودی دارند:

-

توان پردازشی محدود: بسیاری از آنها با CPUهای ردهپایین یا میکروکنترلرها کار میکنند و در انجام کارهای محاسباتی سنگین به مشکل میخورند.

-

حافظه محدود: با RAM حداقلی، ذخیره کردن مدلهای هوش مصنوعی «بزرگ»؟ عملاً شدنی نیست.

-

بهرهوری انرژی: دستگاههای IoT باتریمحور به مدیریت انرژی کارآمد نیاز دارند تا بدون شارژ مکرر یا تعویض باتری، مدت طولانی کار کنند.

-

محدودیتهای پهنای باند شبکه: بسیاری از آنها به اتصالهای ناپیوسته یا کمپهنایباند متکیاند، و گفتوگوی دائمی با سرورهای ابری ناکارآمد یا غیرعملی است.

بیشتر مدلهای هوش مصنوعی برای این دستگاهها بیش از حد بزرگ و پرمصرفاند. اینجاست که SLMها وارد میشوند.

چگونه مدلهای زبانی کوچک (SLMs) کارایی منابع را بهینه میکنند

معماری سبکوزن

SLMها نسخهی لاغرتر و کمحجمترِ مدلهای عظیمی مثل GPT-3 یا GPT-4 هستند. با پارامترهای کمتر (مثلاً DistilBERT حدود ۴۰٪ «بار اضافی» کمتری نسبت به BERT دارد)، آنقدر کوچک هستند که بدون دردسر داخل دستگاههای دارای محدودیت حافظه جا شوند، در حالی که بیشترِ جادوی عملکردشان را حفظ میکنند.

جادوی فشردهسازی

تکنیکهایی مثل کمّیسازی (مثلاً تبدیل وزنها به اعداد صحیح با دقت کمتر که بار محاسباتی را کاهش میدهد) و هرسکردن (بریدن وزنهای اضافه) باعث میشوند مدلها سریعتر و سبکتر شوند. نتیجه؟ زمانهای استنتاج سریعتر و کاهش مصرف انرژی، حتی روی دستگاههایی که توان محاسباتیشان در حد یک گوشی دکمهای است.

کمّیسازی

در مواردی که کمّیسازی اعمال میشود، ردپای حافظه به شکل چشمگیری کاهش مییابد. برای نمونه، یک نسخهی کمّیسازیشده از Mistral 7B ممکن است فقط حدود ۱.۵ گیگابایت حافظه مصرف کند، در حالی که روی سختافزار قدرتمندی مثل NVIDIA RTX 6000 با نرخ ۲۴۰ توکن در ثانیه توکن تولید میکند (Enterprise Technology News and Analysis). این موضوع آن را برای دستگاههای لبهای و کاربردهای زمان واقعی که به پردازش کمتأخیر نیاز دارند، عملی میسازد.

نکته: مطالعات روی LLaMA3 و Mistral نشان میدهد مدلهای کمّیسازیشده همچنان میتوانند در وظایف پردازش زبان طبیعی و بینایی عملکرد خوبی داشته باشند، اما دقتی که برای کمّیسازی انتخاب میشود باید با دقت تعیین شود تا افت عملکرد رخ ندهد. برای مثال، LLaMA3 وقتی به ۲ تا ۴ بیت کمّیسازی میشود، در وظایفی که به درک متنِ بلند (long-context) یا مدلسازی زبانی دقیق نیاز دارند، شکاف عملکردی قابل توجهی نشان میدهد (Papers with Code)، اما در وظایف سادهتر مثل پرسشوپاسخ و سیستمهای گفتوگوی پایه عالی عمل میکند (Hugging Face). خلاصه اینکه هیچ «درخت تصمیم» دقیق و استانداردی برای کمّیسازی بینقص وجود ندارد؛ باید با دادههای مورد استفادهی مشخص، آزمایش و تجربه انجام شود.

هرسکردن

هرسکردن با شناسایی و حذف پارامترهای غیرضروری یا تکراری در مدل کار میکند؛ یعنی عملاً نورونها یا اتصالهایی را کوتاه میکند که سهم معنیداری در خروجی نهایی ندارند. این کار اندازهی مدل را بدون افت بزرگ عملکرد کاهش میدهد. در واقع، پژوهشها نشان دادهاند هرسکردن (Neural Magic – Software-Delivered AI) میتواند اندازهی مدلها را تا ۹۰٪ کاهش دهد، در حالی که بیش از ۹۵٪ دقت اولیه را در مدلهایی مثل BERT حفظ میکند (Deepgram).

روشهای هرسکردن از هرسِ بدونساختار (حذف وزنهای منفرد) تا هرسِ ساختاریافته (حذف کل نورونها یا لایهها) گسترده است. هرس ساختاریافته بهطور ویژه برای افزایش کارایی مدل و سرعت محاسبات مفید است؛ مانند مورد Google’s BERT-Large که در آن ۹۰٪ شبکه میتواند با افت ناچیز دقت هرس شود (Neural Magic – Software-Delivered AI).

مدلهای هرسشده، مثل همتایان کمّیسازیشدهی خود، سرعت و بهرهوری انرژی بهتری ارائه میدهند. برای مثال، PruneBERT توانست ۹۷٪ کاهش وزنها را به دست آورد، در حالی که حدود ۹۳٪ از دقت اولیه را نگه داشت و زمانهای استنتاج را بهطور چشمگیری سریعتر کرد (Neural Magic – Software-Delivered AI). مشابه کمّیسازی، هرسکردن هم نیازمند تنظیم دقیق است تا اجزای حیاتی مدل حذف نشوند، بهویژه در وظایف پیچیدهای مثل پردازش زبان طبیعی.

سازگارکنندههای الگو

مدلهای زبانی کوچک (SLMs) کارآمدند چون میتوانند الگوها را تشخیص دهند و از محاسبهی دوبارهی غیرضروری جلوگیری کنند؛ شبیه یک ترموستات هوشمند که روال شما را یاد میگیرد و بدون اینکه مدام از ابر سؤال کند، دما را تنظیم میکند. این رویکرد که استنتاج تطبیقی نام دارد، محاسبات را کاهش میدهد، انرژی را برای کارهای مهمتر نگه میدارد و عمر باتری را افزایش میدهد.

شواهد دنیای واقعی درباره سازگارکنندههای الگو

-

Google Edge TPU:

Edge TPU گوگل به مدلهای هوش مصنوعی اجازه میدهد استنتاجهای ضروری را بهصورت محلی انجام دهند و نیاز به ارتباط مکرر با ابر را از بین میبرد. با اعمال تکنیکهای هرسکردن و تنُکسازی، گوگل نشان داده مدلهایی که روی Edge TPU اجرا میشوند میتوانند کاهش قابل توجهی در مصرف انرژی و زمان پردازش داشته باشند، در حالی که سطح بالایی از دقت را حفظ میکنند (Deepgram). برای نمونه، در کارهای تشخیص تصویر، TPU روی ویژگیهای کلیدی تمرکز میکند و پردازشهای تکراری را کنار میگذارد و به عملکرد سریعتر و کممصرفتر میرسد. -

Apple’s Neural Engine:

اپل از مدلهای یادگیری تطبیقی روی دستگاههایی مانند iPhone استفاده میکند تا محاسبات را کم کند و وظایفی مثل تشخیص چهره را بهینه سازد. این کار هم مصرف انرژی را کاهش میدهد و هم ارتباط با ابر را کمتر میکند. -

شبکههای عصبی پویا (Dynamic Neural Networks):

پژوهشها روی شبکههای پویا نشان میدهد با فعالسازی انتخابی لایههای مدل بر اساس پیچیدگی ورودی، میتوان تا ۵۰٪ مصرف انرژی را کاهش داد. (منبع: “Dynamic Neural Networks: A Survey” (2021)) -

TinyML Benchmarks:

معیار MLPerf Tiny نشان میدهد مدلهای آگاه به مصرف انرژی چگونه میتوانند با تکنیکهایی مثل بازاستفاده از الگو و پردازش تطبیقی، ردپای انرژی مدلهای هوش مصنوعی روی میکروکنترلرها را بهشدت کاهش دهند (ar5iv). مدلها میتوانند از نتایج محاسبهشدهی قبلی استفاده کنند، محاسبهی دوبارهی دادههای تکراری را حذف کنند و عمر باتری دستگاههایی مانند دوربینهای امنیتی هوشمند یا پایشگرهای سلامت پوشیدنی را افزایش دهند. -

کاربردهای IoT:

نمونهی شاخص سازگاری با الگو در Nest Thermostat دیده میشود که رفتار کاربر را یاد میگیرد و تنظیمات دما را بهصورت محلی تغییر میدهد. با کم کردن تعامل با ابر، مصرف انرژی بهینه میشود بدون اینکه پاسخگویی قربانی شود. SLMها همچنین میتوانند نرخ یادگیری خود را بر اساس فراوانی تعاملات کاربر بهصورت تطبیقی تنظیم کنند و مصرف انرژی را بیشتر بهینه کنند. این توانایی یادگیری محلی آنها را برای خانه هوشمند و IoT صنعتی ایدهآل میکند؛ جاهایی که نیاز به سازگاری دائمی با محیط دارند، بدون هزینهی انرژیِ دسترسی پیوسته به ابر.

شواهد دنیای واقعی درباره سازگارکنندههای الگو: Google Edge TPU در عمل

Google Edge TPU برای انجام استنتاجهای هوش مصنوعی با بازدهی بالا مستقیماً روی دستگاههای لبهای طراحی شده است و یک مطالعهی موردی عالی برای بررسی این است که چگونه تکنیکهای هرسکردن و تنُکسازی میتوانند مدیریت منابع را بهینه کنند. بیایید یک مثال از تشخیص تصویر روی دستگاه IoT مجهز به Edge TPU را بررسی کنیم.

پیادهسازی فنی: بهینهسازی تشخیص تصویر روی Google Edge TPU

در این مثال، یک مدل هرسشده و کمّیسازیشده را مستقر میکنم تا اشیاء را در محیط کارخانه هوشمند تشخیص دهد. هدف این است که قطعات معیوب را روی خط مونتاژ با استفاده از فید دوربین شناسایی کنیم تا تشخیص در زمان واقعی انجام شود، بدون اینکه منابع محاسباتی دستگاه تحت فشار بیش از حد قرار گیرد.

پیشنیازها: مطمئن شوید Python 3.7 یا بالاتر، TensorFlow 2.x، TensorFlow Model Optimization Toolkit و Edge TPU API نصب هستند. دستورالعملها را میتوانید در صفحههای مستندات مربوطه پیدا کنید.

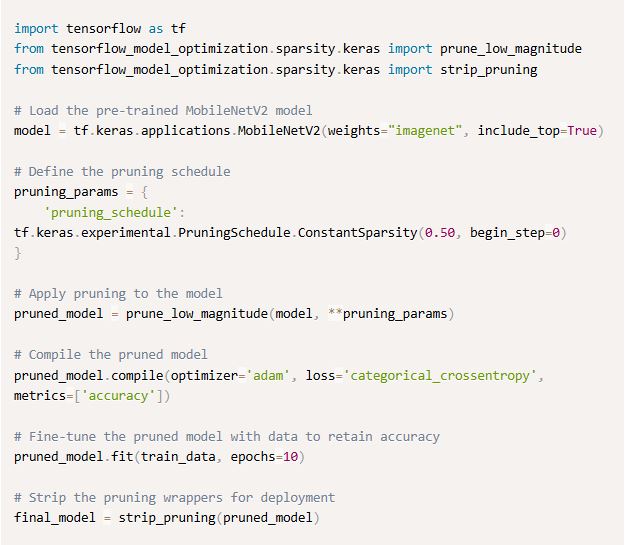

گام ۱: هرسکردن و کمّیسازی مدل

ابتدا از TensorFlow Lite استفاده میکنیم تا یک مدل ازپیشآموزشدیدهی MobileNetV2 را هرس و کمّیسازی کنیم. MobileNetV2 بهخاطر معماری سبکوزن خود برای دستگاههای لبهای مناسب است.

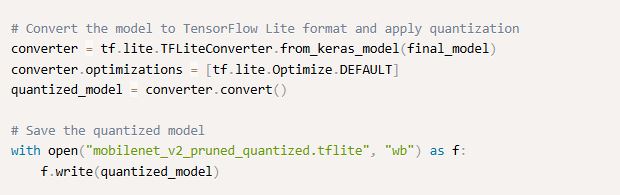

پس از اتمام هرس، اندازهی مدل بهطور قابل توجهی کاهش مییابد و مدل راحتتر در محدودیتهای حافظهی دستگاه لبهای جا میگیرد. حالا به سراغ کمّیسازی میرویم تا بهینهسازی بیشتری انجام دهیم.

گام ۲: استقرار مدل کمّیسازیشده روی Edge TPU

بعد از کمّیسازی، میتوانیم این مدل را با استفاده از Edge TPU runtime روی Google Edge TPU مستقر کنیم. موتور استنتاج با تأخیر کمتر و مصرف انرژی کمتر، مدل را کارآمد اجرا میکند.

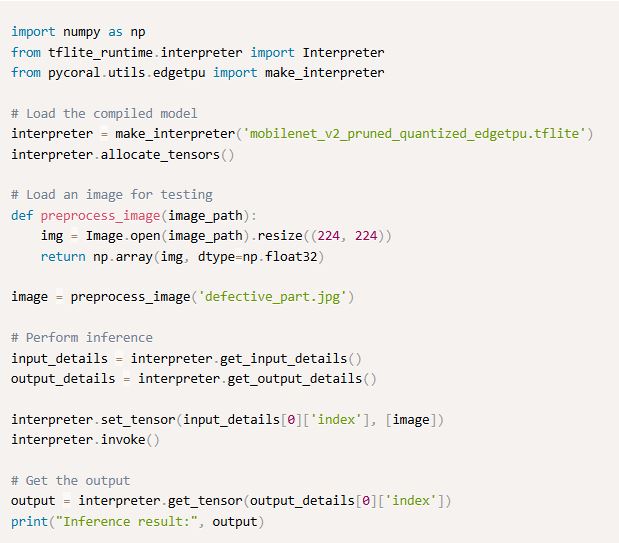

ابتدا مدل را با Edge TPU Compiler کامپایل کنید:

edgetpu_compiler mobilenet_v2_pruned_quantized.tflite

حالا میتوانیم با Python و Edge TPU API استنتاج را اجرا کنیم:

در این حالت، MobileNetV2 کمّیسازیشده و هرسشده روی Edge TPU اجرا میشود و تصاویر را با کارایی بالا طبقهبندی میکند، در حالی که حداقل منابع برق و حافظه را مصرف میکند. این کار باعث میشود بتوان مدلهای هوش مصنوعی مشابه را روی چندین دستگاه در یک کارخانه هوشمند مستقر کرد، بدون نیاز به اتصال دائمی به ابر یا مصرف انرژی بیش از حد.

صرفهجویی انرژی و بهینهسازی پهنای باند

با استقرار این مدلهای بهینهشده مستقیماً روی لبه، کارخانه هوشمند وابستگی به خدمات ابری را کاهش میدهد و هم تأخیر (latency) و هم مصرف پهنای باند را کم میکند. دستگاه فقط هشدارهای حیاتی را به ابر میفرستد؛ مثلاً وقتی نقصی تشخیص داده میشود. این کار پهنای باند را حفظ میکند و هزینههای عملیاتی را پایین میآورد.

نتایج طبقهبندی (نمونه خروجی برای تشخیص قطعه معیوب):

Inference result:

[

{"class": "Defective Part", "confidence": ۰.۹۲},

{"class": "Non-Defective Part", "confidence": ۰.۰۵},

{"class": "Unknown", "confidence": ۰.۰۳}معیارهای کلیدی:

-

نرخ هرس: ۵۰٪ تنُکی (حذف ۵۰٪ وزنها)

-

کاهش اندازه مدل: حدود ۶۰٪ کوچکتر بعد از هرس و کمّیسازی

-

تأخیر: کاهش زمان استنتاج از ۱۵۰ms به ۴۰ms روی Edge TPU

-

مصرف انرژی: ۳۰٪ کمتر نسبت به مدل بهینهنشده

مسیر آیندهی SLMها برای مدیریت منابع

۱. شبکههای حسگر IoT

SLMهایی که در شبکههای حسگر IoT مستقر میشوند میتوانند مصرف منابع را متحول کنند؛ با پیشبینی الگوهای فعالسازی و مدیریت هوشمندترِ ارسال داده.

بهرهوری انرژی: مثلاً حسگرهای رطوبت خاک در یک مزرعه هوشمند را در نظر بگیرید. بهجای پایش و ارسال دائمی داده، این حسگرها میتوانند الگوهای آبوهوا و شرایط خاک را یاد بگیرند. SLMها باعث میشوند فقط وقتی لازم است فعال شوند، مثل قبل از یک دورهی خشکی پیشبینیشده. این کار انرژی را ذخیره میکند و تعداد دفعات ارسال داده را کاهش میدهد و در نتیجه مصرف آب بهینهتر و عمر باتری حسگرها بیشتر میشود.

۲. دستگاههای خانه هوشمند

SLMها میتوانند کاری کنند که دستگاههای خانه هوشمند واقعاً «هوشمند» باشند؛ با یادگیری عادتهای کاربر و بهینهسازی عملیات بدون مصرف بیهوده انرژی.

مثال: یک بلندگوی هوشمند با SLM داخلی میتواند الگوهای گفتار کاربر را تحلیل کند و سیستم تشخیص کلمهی بیدارباش را مطابق آن تنظیم کند. بهجای گوشدادن دائم با توان کامل، دستگاه میتواند مصرف منابع را بر اساس احتمال شنیدن فرمان تنظیم کند و در زمانهای کمفعالیت انرژی را ذخیره کند. همچنین ترموستاتهای مجهز به SLM میتوانند پیشبینی کنند چه زمانی در خانه هستید و از قبل دما را تنظیم کنند، در حالی که وابستگی به بررسیهای دائمی ابری را کاهش میدهند.

۳. دروازههای لبهای در اتوماسیون صنعتی

در محیطهای صنعتی، دروازههای لبهای برای پردازش و تجمیع دادههای حسگرها و ماشینها حیاتیاند. SLMها میتوانند با تشخیص اینکه کدام داده نیاز به توجه فوری دارد و کدام را میتوان بعداً پردازش کرد یا به ابر سپرد، کارایی آنها را افزایش دهند.

بهینهسازی پهنای باند: کارخانهای را تصور کنید که یک دروازه لبهای با SLM دارد. این دروازه میتواند رویدادهای حیاتی مثل خرابی تجهیزات را با تحلیل دادههای لرزش یا دما پیشبینی کند. فقط بینشهای مهم مثل نشانههای اولیه نقص به ابر ارسال میشوند. این کار پهنای باند را حفظ میکند، از بار اضافی داده جلوگیری میکند، تصمیمگیری را در لبه سریعتر میکند و هزینههای عملیاتی را پایین میآورد.

۴. دستگاههای سلامت هوشمند

SLMها میتوانند دستگاههای پوشیدنی پایش سلامت را کارآمدتر کنند و همزمان تحلیل دقیقتری ارائه دهند. مثلاً یک پایشگر ضربان قلب با SLM داخلی میتواند ریتم معمول قلب کاربر را یاد بگیرد و فقط زمانی داده ارسال کند که ناهنجاریهایی مثل آریتمی تشخیص داده شود؛ این کار مصرف انرژی و ارسال داده غیرضروری را کاهش میدهد.

بهرهوری انرژی: بهجای استریم دائمی داده به ابر، یک دستگاه مجهز به SLM میتواند رویدادهای احتمالی سلامتی را پیشبینی کند و فقط در مواقع لازم به کاربر یا پزشک هشدار بدهد. این کار عمر باتری را افزایش میدهد و مصرف پهنای باند را کم میکند و دستگاه را برای پایش بلندمدت و زمان واقعی عملیتر میسازد.

با وارد کردن SLMها به این محیطهای دارای محدودیت منابع، صنایع مختلف از کشاورزی تا تولید میتوانند دستگاههایی هوشمندتر و کارآمدتر داشته باشند و صرفهجویی قابل توجهی در هزینه و انرژی به دست آورند.

جمعبندی

مدلهای زبانی کوچک (SLMs) برای مدیریت منابع در رایانش لبهای بازی را عوض میکنند. با استفاده از معماریهای سبکوزن و استنتاج تطبیقی، SLMها دستگاههایی هوشمندتر و کارآمدتر را در صنایع مختلف ممکن میسازند؛ از شبکههای حسگر IoT تا خانههای هوشمند و اتوماسیون صنعتی. آنها توان، پهنای باند و پردازش را بهینه میکنند بدون آنکه دستگاههای دارای محدودیت منابع را زیر فشار ببرند و راهکاری مقیاسپذیر برای هوشمندی زمان واقعی مبتنی بر هوش مصنوعی در لبه ارائه میدهند. با رشد رایانش لبهای، SLMها نقش کلیدی در هوشمندتر و کممصرفتر کردن دستگاهها خواهند داشت و نوآوری را در بخشهای مختلف جلو خواهند برد.