فشردهشدن بلوغ فناوری در عصر هوش مصنوعی (The Compression of Tech Maturity in the Age of AI)

فناوری در گذشته معمولاً چندین دهه طول میکشید تا توسعه یابد و به بلوغ برسد. اما در عصر هوش مصنوعی، این بازه زمانی بهشدت فشرده شده است. امروز، کریستوفر ساندووال توضیح میدهد که چرا باید در استفاده از هوش مصنوعی در شکل فعلی آن محتاط بود.

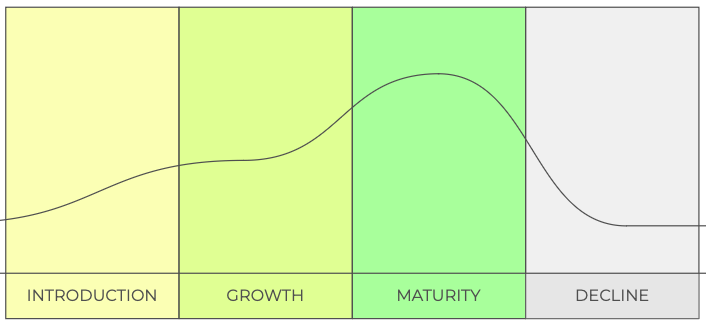

هر فناوری بهطور طبیعی فرآیند بلوغ خود را طی میکند. بدون توجه به نوع فناوری یا گستره کاربرد آن، هر اختراع جدید بهطور طبیعی چرخهای از توسعه اولیه تا بلوغ و سپس حرکت بهسوی منسوخشدن را پشت سر میگذارد.

با این حال، هوش مصنوعی و مدلهای زبانی بزرگ یک چالش جالب ارائه میکنند. آنچه پیشتر چندین دهه زمان میبرد تا توسعه یافته و بالغ شود، اکنون طی چند ماه مورد استفاده گسترده قرار گرفته است. هوش مصنوعی به شکلی انفجاری در کاربرد و پذیرش رشد کرده که هیچکس قادر به پیشبینی آن نبود. در حالی که این فناوری بسیار امیدبخش است، چرخه بلوغ فشرده آن دلیل موجهی برای نگرانی ایجاد میکند.

در ادامه، به این مسئله بلوغ فناوری میپردازیم و چند مثال مشخص ارائه میکنیم که نشان میدهد این موضوع چگونه باعث بروز ریسک در بازار شده است.

مدلی برای بلوغ فناوری

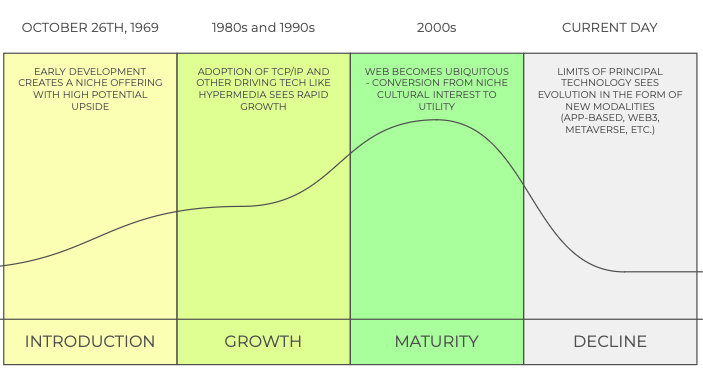

پیش از آنکه بتوانیم مشکلِ فشردهشدن بلوغ فناوری را بررسی کنیم، ابتدا باید تعریف کنیم که بلوغ فناوری چگونه به نظر میرسد. بهطور کلی، تکامل فناوری را میتوان بهعنوان فرآیندی توصیف کرد که طی چند مرحله متمایز رخ میدهد.

در مرحله معرفی، معمولاً ویژگیهای پایهای فناوری شکل میگیرد که آن را برای پذیرش جذاب میکند. این مرحله زمانی است که نوآوران و پذیرندگان اولیه، فناوری جدید را با امید به ایجاد تحول و نوآوری میپذیرند. فناوری در این مرحله کامل نیست — در بسیاری از موارد تنها ابتداییترین شکل راهحل را ارائه میکند — اما در عین حال وعده کافی برای جذب توجه دارد.

در مرحله بعد، رشد محصول اولیه را مشاهده میکنیم. در این مرحله، پذیرندگان اولیه باعث گسترش بیشتر پذیرش میشوند و با تکامل فناوری، شاهد ایجاد جذابیت در بازار انبوه و نوآوریهای بیشتر هستیم. فناوری در این مرحله بهسمت استاندارد شدن حرکت میکند و امکان تکرار و تکامل فراهم میشود و تجربهای پایدار اما در حال بهبود برای پذیرندگان اولیه ارائه میدهد.

سپس فناوری وارد مرحله بلوغ میشود. مرحله بلوغ زمانی است که فناوری به توسعههای نهایی خود میرسد؛ جایی که تجربیات جدید و نوآورانه جای خود را به راهحلهای پایدار و فراگیر میدهند. در این مرحله، اکثریت دیرهنگام کاربران به فناوری میپیوندند و محصولات مبتنی بر آن تقریباً به وضعیت همهگیر میرسند.

در نهایت، فناوری وارد مرحله افول آهسته میشود. در این مرحله، مشکلات فناوری شروع میکنند به سنگینتر شدن نسبت به مزایای آن و این امر موجب شکلگیری نوآوریها، تکرارها و توسعههای جدید میشود. در این مرحله، عقبماندهها معمولاً با قیمت پایین وارد فناوری میشوند اما فایده آن بهشدت کاهش یافته است.

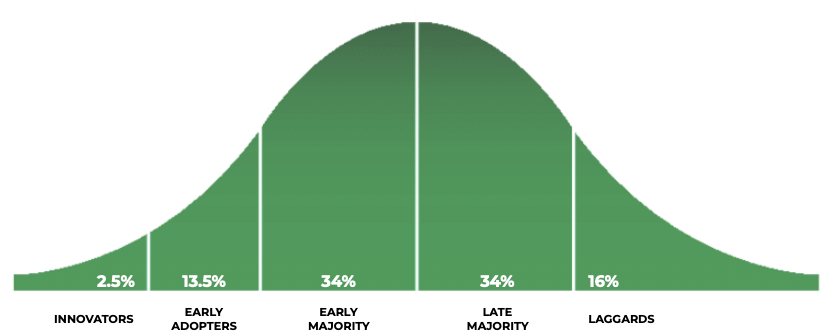

نکته مهم این است که این الگو را میتوان در طیف وسیعی از فناوریها — از کشاورزی گرفته تا هواپیماهای جت — مشاهده کرد. نکته کلیدی درک این الگو و ارتباط آن با منحنی زنگولهای پذیرش است. بخش عمده پذیرش فناوری در مراحل رشد و بلوغ رخ میدهد، زمانی که فناوری برای استفاده گسترده آماده میشود.

بهعنوان مثال، میتوان به نحوه توسعه اینترنت در طول زمان نگاه کرد. در مثال زیر، اینترنت و وب جهانی بهعنوان یک موضوع یکپارچه در نظر گرفته میشوند، زیرا از دید کاربر نهایی، محصولی مکمل هستند، هرچند از نظر فنی تفاوتهایی دارند.

این چرخه زمانی جالبتر میشود که فشار ناشی از پذیرش را در نظر بگیریم. در طول هر مرحله، پذیرش همراه با ریسکها و مزایای خاصی است. اگر خیلی زود پذیرش کنید، ممکن است از فناوریای تحولآفرین پیش از همه رقبا استفاده کنید و مزایای بزرگی کسب کنید. از سوی دیگر، اگر خیلی دیر پذیرش کنید، ممکن است از فناوریای استفاده کنید که دیگر منسوخ شده در حالی که رقبا به سراغ بهترین راهحل جدید رفتهاند.

این وضعیت نوعی فشار در چرخه فناوری ایجاد میکند. این یکی از دلایلی است که باعث میشود اغلب شاهد هیجان و توجه زیاد در الگوهای قابل پیشبینی باشیم، بهویژه زمانی که اکثریت اولیه شروع میکنند به کسب نتایج ملموس از سرمایهگذاری خود.

مشکل بلوغ هوش مصنوعی

هوش مصنوعی افزایش شگفتانگیزی در پذیرش تجربه کرده است. برخلاف چرخه توسعه معمول که در آن محصول معمولاً در اواخر مرحله رشد یا اوایل بلوغ به بیشترین تعداد کاربران میرسد، هوش مصنوعی حتی در مراحل بسیار ابتدایی، شاهد انفجار در استفاده بوده است.

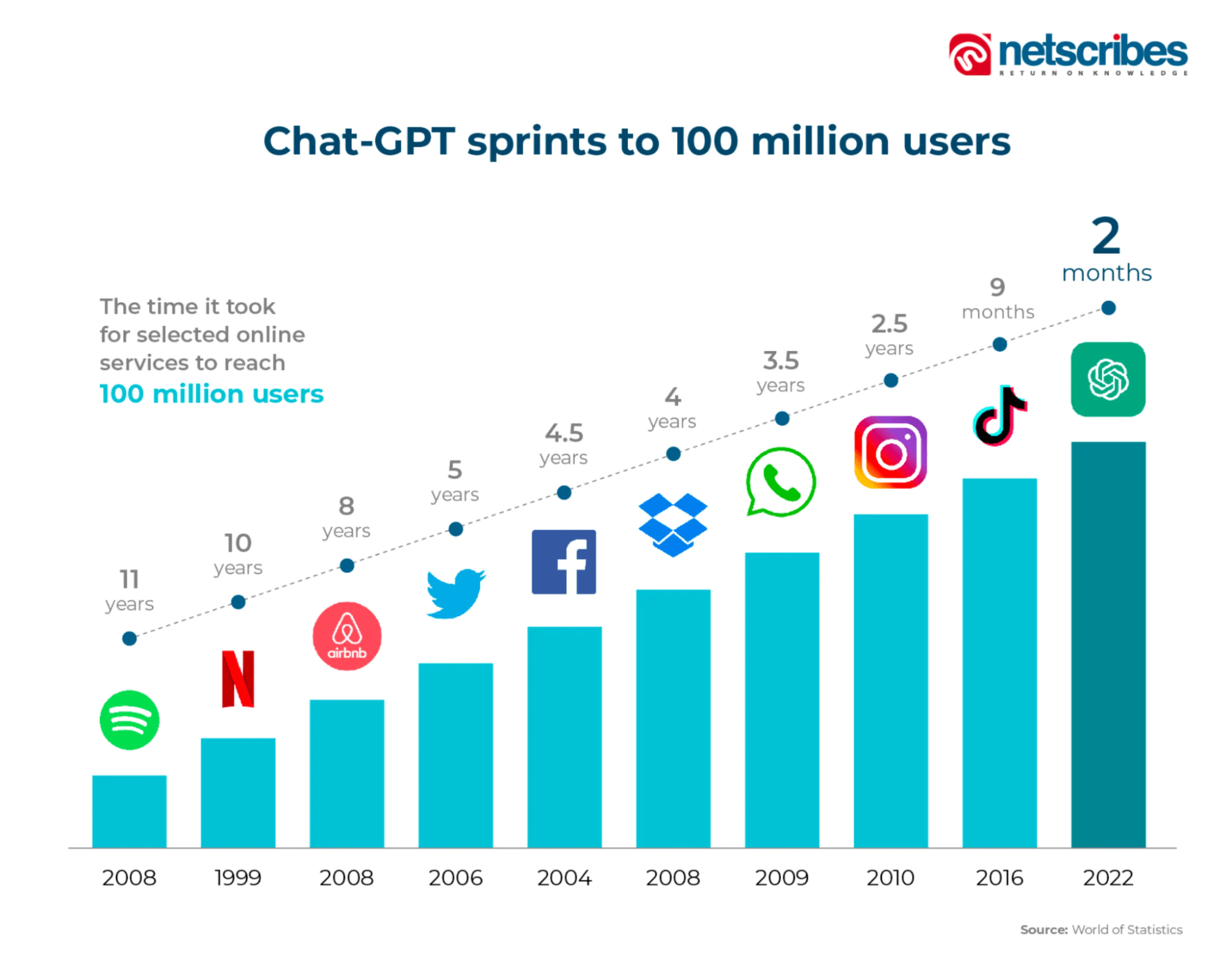

یک مثال روشن از این روند، ChatGPT از OpenAI است. براساس گزارش Netscribes، ChatGPT تنها در دو ماه به نخستین ۱۰۰ میلیون کاربر خود رسید. در مقایسه با فناوریهای روزمره دیگر، این موضوع کاملاً خارقالعاده است. حتی TikTok، با وجود داشتن یک پایگاه کاربری آماده پس از تعطیلی Vine و Musical.ly، نه ماه طول کشید تا به ۱۰۰ میلیون کاربر برسد. رقیب سریع دیگر اینستاگرام بود که دو و نیم سال زمان برد تا به این سطح برسد. نمونهای متداولتر اسپاتیفای است که ۱۱ سال طول کشید و چندین نسخه از محصول را پشت سر گذاشت تا به رکورد ۱۰۰ میلیون کاربر برسد.

به بیان ساده، تعداد بسیار کمی از فناوریها چنین رشد سریعی در دیدهشدن و جذب کاربر داشتهاند. بهدلیل همین فشردهشدن چرخه بلوغ و مسیر جذب کاربر، ما شاهد پذیرش گسترده هوش مصنوعی هستیم، حتی اگر این فناوری هنوز در مراحل اولیه خود باشد.

هوش مصنوعی اکنون در چه مرحلهای است؟

برای برخی، اینکه گفته شود هوش مصنوعی هنوز در مرحله نسبتاً ابتدایی قرار دارد ممکن است گزارهای قوی بهنظر برسد. واقعیت این است که هوش مصنوعی، با وجود امیدبخشی، هنوز شکافهای بسیاری در توسعه و قابلیتها دارد و فاصله زیادی تا یک فناوری بالغ دارد. برای روشنتر شدن موضوع، به وضعیت فعلی مدلهای هوش مصنوعی، بهویژه مدلهای زبانی بزرگ (LLMها)، نگاه میکنیم.

هوش مصنوعی در چه زمینههایی عملکرد عالی دارد؟

هوش مصنوعی در شکل فعلی خود اساساً یک مدل پیشبینیکننده است. LLMها طوری طراحی شدهاند که یک کلمه یا جمله را دریافت کرده و محتملترین خروجی را بر اساس مجموعه دادههای خود ایجاد کنند. این امر باعث ایجاد سیستمی شده که عملکرد خوبی دارد — البته تا زمانی که مجموعه داده کافی برای ارائه زمینه وجود داشته باشد.

بنابراین، AI در موارد زیر بسیار خوب عمل میکند:

-

تشخیص الگو

-

کشف روندها و زمینهها در مقیاس بالا

-

طبقهبندی محتوا، خلاصهسازی و مقایسه

-

تولید متن و تصاویر بر اساس محتواهای قبلی

اما نکته کلیدی این است که این تواناییها بهشدت به زمینه وابستهاند، و کیفیت این زمینه کاملاً به کیفیت دادههایی بستگی دارد که مدل با آنها آموزش دیده است.

هوش مصنوعی در چه زمینههایی عملکرد ضعیفی دارد؟

به همین دلیل، مدلهای فعلی در وظایفی که داده یا زمینه کافی ندارند، ضعف قابلتوجهی دارند. تولید بدون راهنمایی میتواند بسیار دشوار باشد. هرچند تکنیکهایی مانند یادگیری صفر-نمونه پیشرفتهایی داشتهاند، اما همچنان به دادههایی نیاز دارند که از نظر موضوعی به مسئله اصلی نزدیک باشند.

نمونه روشن این مشکل را میتوان در تولید تصاویر انسانی مشاهده کرد. اگر از هوش مصنوعی بخواهید یک دست انسان تولید کند، خروجی ممکن است در ظاهر درست باشد — یک اندام انسانی با پوست و چند انگشت — اما با نگاه دقیقتر، اغلب موارد زیر دیده میشود:

-

انگشتهای اضافه

-

پرسپکتیوهای اشتباه

-

بافتهای عجیب

-

اشکالات ناشی از تلاش مدل برای بازتولید یک مفهوم مبهم

هوش مصنوعی همچنین در موارد زیر ضعف دارد:

-

تصمیمگیریهای مبهم

-

استنتاج و منطق پیچیده

-

مباحث اخلاقی و فلسفی

-

مواردی که «پاسخ درست» مشخصی ندارند

در چه مواردی بهطور جدی مشکل دارد؟

در نهایت، مواردی وجود دارند که هوش مصنوعی شدیداً با آنها دستوپنجه نرم میکند:

-

شفافیت و انطباق نظارتی (مثلاً با GDPR)

-

مشکل نشت دادهها در فرآیند آموزش مجدد مداوم

-

توهم یا تولید اطلاعات نادرست با اعتماد کامل

-

آلودگی دادههای آموزشی و حملات مبتنی بر داده

-

آسیبپذیریهای امنیتی در سطح معماری مدل

مدلهای زبانی بزرگ حتی بهحدی آسیبپذیرند که طی سالهای اخیر یک «OWASP Top 10» اختصاصی برای آنها تدوین شده است.

واقعیت هوش مصنوعی

اگرچه پذیرش هوش مصنوعی مانند یک فناوری بالغ است، اما در عمل هنوز بالغ نیست. این بدان معنا نیست که نباید از آن استفاده کرد — بلکه باید از آن بهصورت آگاهانه و هدفمند استفاده کرد.

به شکل ساده:

چند درصد از رانندگان میتوانند بهطور ساده توضیح دهند بنزین چیست؟ بسیاری.

اما چند درصد کاربران ChatGPT میتوانند مفهوم «zero-shot learning» را توضیح دهند؟ بسیار کم.

یک مطالعه موردی

این مشکلات صرفاً نظری نیستند. به یک نمونه واقعی نگاه کنیم.

در وضعیت فعلی، هوش مصنوعی بهطور گسترده برای تولید کدهای پایه و کدهای تکراری استفاده میشود، و برخی مدیران کسبوکار حتی مطرح کردهاند که AI میتواند بخش زیادی از فضای توسعه نرمافزار را جایگزین کند.

اما واقعیت فعلی هوش مصنوعی از این ادعاها پشتیبانی نمیکند، حتی اگر بازار طوری رفتار کند که انگار این فناوری کاملاً بالغ است.

نمونه عالی این مشکل را میتوان در کار «بار لانیادو»، پژوهشگر امنیتی در Lasso Security مشاهده کرد. او با استفاده از یک روش نوآورانه، دقیقاً از همین فشردگی تکنولوژیک استفاده کرد تا یک آسیبپذیری عظیم را در مدلهای زبانی بزرگ پیدا کند.

روند کار به این شکل بود:

-

آنها از مدل خواستند فهرستی از پرسشهای رایج برنامهنویسی تولید کند.

-

مدل در مواردی پکیجهایی را پیشنهاد داد که اصلاً وجود خارجی نداشتند.

-

تیم این پکیجهای خیالی را با نسخههای واقعی اما مخرب در مخازن اینترنتی ساخت.

-

از آن پس، هر زمان مدل دچار «توهم» میشد و این نامها را پیشنهاد میکرد، کاربران آن را جستوجو کرده و نسخه مخرب واقعی را پیدا میکردند.

این پکیجها برای پژوهش ساخته شده بودند — نه برای آسیب واقعی.

اما سوال اصلی این است:

اگر یک شرکت بزرگ از مدل استفاده میکرد و یکی از این پکیجهای مخرب را نصب میکرد، چه؟

آیا تیم توسعه حتی متوجه میشد؟

نتیجهگیری: در استفاده از هوش مصنوعی احتیاط کنید

این مقاله برای این نوشته نشده که بگوید نباید از LLMها و هوش مصنوعی استفاده کرد — برعکس.

این فناوریها خارقالعاده هستند و میتوانند تاثیرات عظیمی بر توسعه، بهبود و کیفیت سیستمها داشته باشند.

اما نکته اصلی این است:

-

هوش مصنوعی آنقدر که بهنظر میرسد بالغ نیست

-

پذیرش سریع آن، بیش از حد جلوتر از توسعه واقعی آن است

-

استفاده بیمحابا میتواند خطرهای بزرگی ایجاد کند

این فناوری در آینده مانند اینستاگرام یا اسپاتیفای همهجا خواهد بود.

اما فعلاً، احتیاط ضروریترین رویکرد است.

توجه ویژه به جزئیات و سطح بالایی از دقت لازم است تا از آسیبهای بالقوه در مقیاسی که بهسادگی قابل جبران نیست جلوگیری شود.