یک نقشه راه برای مقیاسپذیری فراتر از پایلوتها (A Blueprint for Scaling Beyond Pilots)

وارد هر اتاق هیئتمدیرهای در سال ۲۰۲۵ شوید و همان داستان را خواهید شنید: «ما کاملاً روی هوش مصنوعی سرمایهگذاری کردهایم.»

اعداد نیز این اشتیاق را تأیید میکنند؛ گزارش Tech Trends 2025 شرکت Deloitte نشان میدهد که ۹۴٪ از سازمانهای جهانی امسال سرمایهگذاریهای خود در AI را افزایش دادهاند و McKinsey نیز اشاره میکند که ۸۸٪ از سازمانها گزارش دادهاند که حداقل در یک بخش از AI استفاده میکنند. روی کاغذ، منحنی پذیرش غیرقابل توقف بهنظر میرسد.

اما اگر کمی عمیقتر نگاه کنید، تصویر بسیار متفاوتی آشکار میشود.

گزارش MIT با عنوان State of AI in Business 2025 بیان میکند که ۹۵٪ پایلوتهای GenAI قادر به مقیاسپذیری نیستند و تنها ۵٪ باعث افزایش قابل اندازهگیری درآمد میشوند.

شکاف بین اشتیاق به AI و اجرای AI هیچ ارتباطی با قابلیت مدلهای AI ندارد. تکنولوژی آماده است. شکاف واقعی آمادگی سازمانی است و در بیشتر سازمانها، زیرساخت دیجیتال به سادگی برای AI آماده نیست.

این مقاله توضیح میدهد چرا شرکتها در پایلوتهای AI گیر میکنند و واقعاً چه نیاز است تا AI از آزمایشهای پراکنده به یک توانایی سازمانی قابلاتکا در سطح تولید تبدیل شود.

چرا پایلوتها مقیاسپذیر نمیشوند؟

قبل از ورود به نقشه راه، بیایید بفهمیم چه چیزی ۵٪ برتر را که موفق به مقیاسپذیری میشوند از دیگران جدا میکند. موانع در پنج دسته بحرانی قرار میگیرند:

۱. شکاف همراستایی تجاری

بسیاری از پایلوتهای AI به عنوان آزمایشهای تکنولوژی آغاز میشوند نه ابتکارهای تجاریمحور. یک تیم علم داده از یک مدل جدید هیجانزده میشود، یک اثبات مفهوم میسازد، دقت چشمگیری نشان میدهد و سپس… هیچ اتفاقی نمیافتد. وقتی اهداف از KPIهای قابلاندازهگیری جدا باشند، پروژهها برای بهدست آوردن حمایت مدیران یا بودجه مقیاسپذیری دچار مشکل میشوند.

خلأ مالکیت: تحقیقات Gartner شکافهای رهبری را برجسته میکند: در حالی که بسیاری از هیئتمدیرهها AI را در اولویت قرار میدهند، مالکیت آن همچنان نامشخص است. CEOها اغلب پیشقدم هستند اما مالکیت در سطح C-suite پراکنده است. این سردرگمی در سراسر سازمانها منتشر میشود—تیم علم داده فرض میکند واحدهای تجاری مالک استفاده هستند، واحدهای تجاری فکر میکنند IT مالک پیادهسازی است، و IT تصور میکند علم داده مالک نتایج است. در نتیجه، دموهای چشمگیر هرگز تبدیل به ارزش تجاری نمیشوند زیرا هیچکس تعریف نمیکند «ارزش» دقیقاً چیست.

۲. دیوار پیچیدگی یکپارچهسازی

۷۸٪ از سازمانها با مسئله یکپارچهسازی AI مشکل دارند. عاملهای AI زمانی که با APIهای ناسازگار، مستندات قدیمی و سیستمهای تکهتکه مواجه میشوند، از کار میافتند. وقتی سازمانها مدلهای AI را از ارائهدهندگان مختلف استفاده میکنند، مصرف مستقیم مدلها از برنامهها باعث پیچیدگی یکپارچهسازی نقطهبهنقطه میشود که مقیاسپذیری را تقریباً غیرممکن میسازد.

واقعیت: هر بخش APIها را با استانداردهای متفاوت ساخته است، مستندات با رفتار واقعی تناقض دارد، الگوهای احراز هویت در سیستمها فرق دارند و سیستمهای قدیمی برای اتصال به ۶-۹ ماه توسعه میانافزار نیاز دارند.

۳. آشفتگی جریانکار و ابزارها

یک فرایند معمولی سازمانی در یک سیستم اتفاق نمیافتد. این فرایند در ۱۰ تا ۱۵ ابزار مختلف پخش شده، با داده و زمینهای که از طریق ایمیل، پیامهای Slack، فایلهای پیوست اکسل و تحویلهای دستی بین تیمها جابجا میشود. هیچ موتور جریانکار مرکزی برای سازماندهی وجود ندارد—این سیستم توسط حافظه انسانی و فرایندهای غیررسمی نگهداشته میشود.

اغلب یکپارچهسازیهای شکننده با راهحلهای دستی وجود دارد و AI این شکنندگی را بزرگتر میکند چون APIهای بیشتری تولید میکند، به سرعت پاسخ بیشتری نیاز دارد و توانایی انسانی برای دور زدن مشکلات هنگام شکست یکپارچهسازیها را ندارد.

۴. مشکل بنیاد داده

AI با داده باکیفیت شکوفا میشود، اما بیشتر سازمانها در سیلوهایی فعالیت میکنند که داده در آنها ناسازگار، ناقص یا غیرقابلدسترسی است. داده مشتریان در چندین سیستم مختلف با چندین شمای متفاوت ذخیره شده و هیچ منبع واحد حقیقت وجود ندارد.

۵. فقدان کنترلهای عملیاتی AI

کمتر شرکتی خطوط MLOps (عملیات مدلهای یادگیری ماشین) را برای مدیریت نسخهسازی، تست، استقرار و نظارت مدلها ایجاد کرده است. انتقال از نمونه اولیه به تولید به زیرساخت مقیاسپذیر و اتوماسیون نیاز دارد. بسیاری از سازمانها میتوانند مدل بسازند، اما استقرار پایدار آنها، نظارت بر عملکرد و تضمین حاکمیت در مقیاس، مهارتها و ابزارهای متفاوتی میطلبد.

بدون کنترلهای عملیاتی مناسب، موفقترین مدلهای شما در تولید بهطور بیصدا تحلیل میروند.

۶. چالشهای حاکمیت، فرهنگ و ریسک

Gartner پیشبینی میکند ۶۰٪ از ابتکارهای AI تا سال ۲۰۲۷ به دلیل مقاومت کارکنان شکست خواهند خورد—بالاتر از موارد نقلشده توسط مدیران. نگرانیهای حریم خصوصی داده با ۴۲٪ بالاترین ریسک GenAI محسوب میشود و خطاهای هذیانی (hallucinations) بهعنوان مشکلات کلیدی قابلیتاعتماد ذکر شدهاند. معمولاً پروژههای GenAI بین اثباتمفهوم و تولید در «لیمبو» گیر میکنند چون حاکمیت لازم برای تأیید آنها وجود ندارد.

تیمها تحت فشارند که سریع حرکت کنند، اما بدون محافظهای لازم، تیمهای ریسک و تطبیق نمیتوانند چراغ سبز دهند—و پایلوتهای ارزشمند در حاشیه باقی میمانند.

خبر خوب: این مشکلات قابلحل و دارای راهکارهای اثباتشده هستند. سازمانهایی که امروز با موفقیت AI را مقیاس میدهند، زیرساختهایی ساختهاند که این چالشها را قابلمدیریت میکند.

نقشه راه مقیاسپذیری AI در سازمان

موفقیت در مقیاسپذیری AI نیازمند یک تحول جامع در استراتژی، سیستمها، افراد و حاکمیت است.

گام ۱: شروع با موارد استفاده باارزش و بهخوبی تعریفشده

مقیاسپذیری AI با مشکلات تجاری واضح آغاز میشود، جایی که AI هم اهرمسازی و هم ماندگاری ایجاد میکند؛ نه جلسات بارش فکری یا «بیایید این مدل را امتحان کنیم.»

چند نکته برای ارزیابی:

-

اهمیت استراتژیک: آیا این مورد استفاده یک شاخص سخت تجاری—درآمد، هزینه، ریسک یا رضایت مشتری—را جابهجا میکند؟

-

تکرارپذیری عملیاتی: آیا این کار صدها یا هزاران بار در هفته انجام میشود؟

-

ریسک قابلمدیریت: آیا میتوانید با AI مشاورهای یا کمکی شروع کنید پیش از اتوماسیون کامل؟

عملیات داخلی و تصمیمهای کمریسک نقاط شروع بهتری هستند.

گام ۲: ساخت تیمهای تحویل AI میانعملکردی

تیمهای ترکیبی (Fusion Teams) بسازید نه آزمایشگاههای جداگانه، زیرا مقیاسپذیری AI نیازمند یکپارچهسازی است و یکپارچهسازی نیازمند همکاری.

ترکیب تیم:

-

رهبر محصول (تعریف ارزش + موفقیت)

-

مالک فرآیند (مالک جریانکار)

-

رهبر مهندسی (یکپارچهسازی + زیرساخت)

-

رهبر داده/ML (مدلها + ارزیابی)

-

نماینده ریسک/تطبیق

-

رهبر مدیریت تغییر

این روش ماهها رفتوبرگشت را حذف میکند. در غیر اینصورت AI تبدیل به یک مسابقه امدادی میان ذینفعان ناهماهنگ میشود—یکی از بزرگترین دلایل شکست پایلوتها.

گام ۳: ساخت پایه آمادگی سازمانی

این مهمترین بخش است و همان بخشی است که اغلب دستکم گرفته میشود.

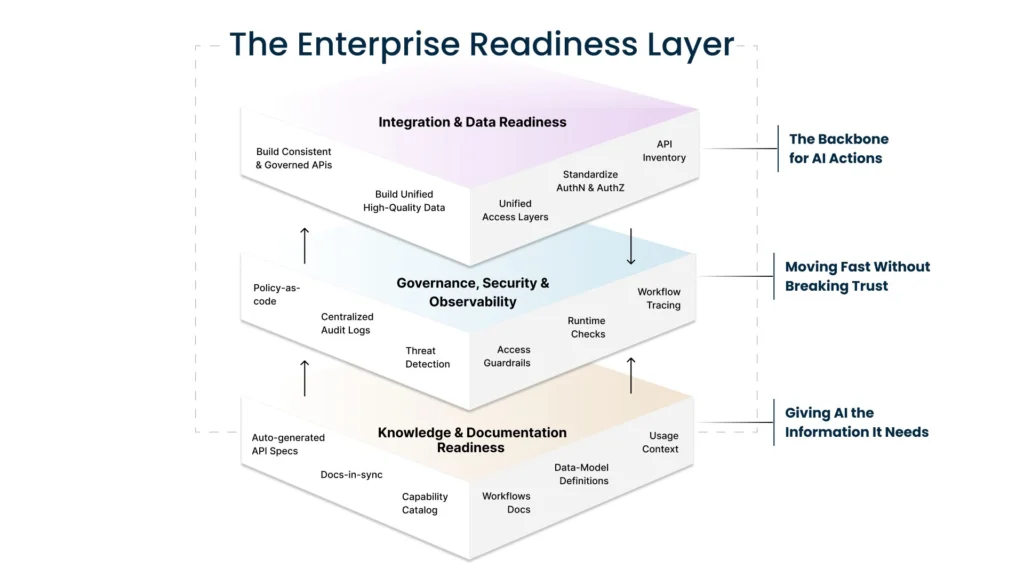

سازمانهایی که AI را سریع مقیاس میدهند چیزی میسازند که میتوان آن را Enterprise Readiness Layer نامید: زیرساختی که سازمان شما را برای AI قابلدسترسی، قابلهدایت و قابلاعتماد میکند.

این پایه سه لایه اساسی دارد که با هم کار میکنند—در بخش بعدی عمیقتر بررسی میکنیم.

گام ۴: پیادهسازی عملیات هوش مصنوعی (MLOps)

عملیات AI در تولید جایی است که اکثر سازمانها دچار مشکل میشوند. با AI مانند هر سیستم حیاتی دیگر رفتار کنید: با عملیات درست.

-

نسخهسازی مدل و Prompt — پیگیری دقیق اینکه چه چیزی کجا اجرا میشود

-

ارزیابیهای خودکار — تستهای منظم دقت، سوگیری و ایمنی

-

نظارت و تشخیص Drift — هشدار هنگام تغییر رفتار یا داده ورودی

-

Guardrails و سیاستها — قوانین رمزگذاریشده برای آنچه AI میتواند و نمیتواند انجام دهد

-

انسان در حلقه برای اقدامات پرریسک

-

روشهای استقرار ایمن — انتشار Blue/Green، Canary و بازگشت سریع

لایه آمادگی سازمان — بررسی عمیق

این لایهها زیرساخت حیاتی را تشکیل میدهند که AI را از آزمایشهای جداگانه به اتوماسیون سیستممحور منتقل میکند.

لایه ۱: آمادگی یکپارچهسازی و داده (قابلدسترسکردن سازمان برای AI)

AI باید APIها را فراخوانی کند، داده بکشد، جریانکارها را راهاندازی کند و در سیستمهایی حرکت کند که هرگز برای گفتوگو با هم ساخته نشدهاند.

۱.۱ ساخت APIهای سازگار و دارای حاکمیت (ستون فقرات انجام اقدامات AI)

اگر APIهای شما ناسازگار، بدون مستندات یا دارای رفتارهای متفاوت باشند، عاملهای AI هنگام یکپارچهسازی خراب میشوند.

باید:

-

قراردادهای سازگار API را اجرا کنید

-

احراز هویت و مجوزدهی را استاندارد کنید

-

الگوهای نسخهسازی و مدیریت خطا را اتخاذ کنید

-

موجودی کاملی از APIها داشته باشید

-

ورودیها، خروجیها، مالکیت و هدف را مستند کنید

این کار پیچیدگی یکپارچهسازی—بزرگترین مانع گزارششده توسط CIOها—را از بین میبرد.

۱.۲ ساخت داده یکپارچه و باکیفیت (ستون فقرات فهم AI)

AI با داده ناسازگار یا تکراری تصمیمهای اشتباه میگیرد.

نیاز است:

-

مدلهای داده استاندارد برای موجودیتهای اصلی

-

لایه دسترسی واحد به داده

-

حاکمیت داده حساس

-

چکهای خودکار کیفیت داده

-

سازگاری موجودیتها در سیستمها

۱.۳ استانداردسازی جریانکار (ستون فقرات زمینه و درک AI)

اگر APIها در جریانکارهای انتها به انتها سازماندهی نشوند، AI مجبور است ترتیب را حدس بزند.

باید:

-

جریانکارهای API مبتنی بر مورد استفاده طراحی کنید

-

منطق ارکستریشن را تعریف کنید

-

رویدادها و محرکها را مدل کنید

-

قوانین Retry و Timeout را استاندارد کنید

-

ارکستریشن را متمرکز کنید

لایه ۲: حاکمیت، امنیت و قابلمشاهدهبودن (حرکت سریع بدون از بینبردن اعتماد)

وقتی سازمان برای AI قابلفهم شد، چالش بعدی اطمینان از ایمنی و پیشبینیپذیری است.

۲.۱ امنیت و Guardrails بهصورت پیشفرض

-

سیاستهای دسترسی به داده بهصورت کد

-

احراز هویت سازگار

-

ثبت متمرکز تمام فعالیتهای API

-

تشخیص ناهنجاری در الگوهای دسترسی

-

محافظت در برابر Prompt Injection

-

محدودیت نرخ برای حفاظت از سیستمهای قدیمی

-

برچسبگذاری دادههای حساس

۲.۲ ساخت حاکمیت AI

حاکمیت باید سرعتدهنده باشد نه مانع.

-

بررسیهای خودکار تطبیق

-

رمزگذاری قوانین حریم خصوصی، سوگیری و ایمنی

-

جریانهای تأیید برای خروجیهای پرریسک

-

نظارت بر خطا، هذیان و Drift

-

فرآیندهای بازبینی یکپارچه

۲.۳ ساخت قابلیت مشاهده در تمام جریانکارهای AI

-

ردیابی انتها به انتها

-

نظارت بر دقت، تأخیر و ناهنجاریها

-

تشخیص Drift رفتاری و دادهای

-

هشدارها و گزارشهای قابلممیزی

لایه ۳: آمادگی دانش و مستندات (دادن اطلاعات موردنیاز به AI)

AI وقتی مستندات اشتباه یا قدیمی باشد، شکست میخورد.

۳.۱ تولید خودکار مستندات بدون Drift

-

تولید OpenAPI از منبع

-

اعتبارسنجی مثالها در CI/CD

-

جلوگیری از استقرار در صورت شکست مستندات

-

ثبت واحد مستندات

۳.۲ ساخت کاتالوگ واحد قابلیتهای سازمان

AI باید بداند:

-

چه APIهایی وجود دارد

-

چه جریانکارهایی قابلفعالسازی است

-

چه دادهای در دسترس است

-

مالک هر قابلیت کیست

کاتالوگ شامل:

-

APIها

-

Workflowها

-

Data Models

-

Documentation

این کاتالوگ نقشه سازمان برای AI است.

مسیر پیشرو

تحول AI درباره ساخت زیرساخت سازمانی و فنی است که AI در آن رشد کند. میانبُری وجود ندارد، اما سرمایهگذاری بازدهی مرکب دارد.

نقشه راه مشخص است. الگوها اثبات شدهاند.

آیا آمادهاید فراتر از پایلوتها حرکت کنید؟

گام بعدی شما: ارزیابی وضعیت فعلی در سه لایه.

شکافها کجاست؟ بلوغ پایه شما در چه سطحی است؟

از این نقشه راه برای ساخت برنامه تحول خود استفاده کنید.