فیناپس بکاند (FinOps)

نکات کلیدی

- ادغام زودهنگام FinOps در معماریهای مایکروسرویس بهطور چشمگیری هزینههای ابر و ناکارآمدیهای عملیاتی را کاهش میدهد.

- بنچمارکهای تجربی نشان میدهند انتخاب زبان برنامهنویسی و راهبرد استقرار میتواند به تفاوتهای قابلتوجهی در هزینه و عملکرد مایکروسرویسها منجر شود.

- اجرای یک سیاست قدرتمند برچسبگذاری منابع در زمان تأمین (Provisioning) شفافیت هزینه را افزایش میدهد و نسبتدهی دقیق مخارج ابری را تضمین میکند.

- اتوماسیون در مقیاسدهی خودکار و مدیریت منابع، کارایی هزینه و بهرهبرداری از منابع را بهطور محسوسی بهبود میدهد.

- جاسازی حلقههای بازخورد پیوسته بین مهندسی و مالی از طریق داشبوردهای هزینهی لحظهای و بررسیهای هزینه در CI/CD، صرفهجوییهای پایدار و قابلاندازهگیری در هزینههای ابر ایجاد میکند.

مقدمه

مایکروسرویسهای بومی ابر، مهندسی بکاند را دگرگون کردهاند و سازمانها را برای مقیاسپذیری سریع، ارائه بهروزرسانیهای پرتکرار و حفظ تابآوری سیستم آماده کردهاند. با این حال، این انعطافپذیری اغلب چالشهای مهمی در مدیریت هزینههای عملیاتی به همراه دارد. هزینههای غیرمنتظرهی ابر معمولاً به دلیل تخصیص تکهتکهی منابع، راهبردهای مقیاسدهی ناکارآمد، و دید محدود نسبت به هزینهها رخ میدهند.

این مقاله «Backend FinOps» را معرفی میکند؛ یک رویکرد نظاممند که برای تیمهای مهندسی بکاند طراحی شده تا انضباط مالی را در طراحی، استقرار و عملیات مایکروسرویسها نهادینه کنند.

این مقاله بنچمارکهای تجربی را پوشش میدهد که بدهبستانهای هزینه و عملکرد را در زبانهای برنامهنویسی و گزینههای مختلف استقرار برجسته میکنند. همچنین بهترینروشها برای برچسبگذاری منابع، سیاستهای مقیاسدهی خودکار، و ادغام مدیریت هزینه در پایپلاینهای CI/CD را معرفی میکند. مطالعات موردی دنیای واقعی برخی پیادهسازیهای موفق FinOps و اثرات قابلاندازهگیری آنها را نشان میدهند.

در پایان، خوانندگان راهبردهای عملی برای مدیریت و بهینهسازی پیشدستانه هزینههای ابر، همراستا کردن تصمیمهای مهندسی با اهداف مالی، و پیشبرد کارایی هزینهی مداوم در محیطهای مایکروسرویس بکاند به دست میآورند.

چالشهای اصلی

مدیریت مؤثر هزینههای پیچیدهی ابر در مایکروسرویسها میتواند دشوار باشد، چون ناکارآمدیهای کوچک خیلی سریع روی هم جمع میشوند و در نهایت هزاران دلار هزینهی قابلاجتناب ایجاد میکنند.

پراکندگی منابع: محرک پنهان هزینه در مایکروسرویسها

پراکندگی منابع بیسر و صدا بودجه را در مایکروسرویسها تخلیه میکند. در معماری یکپارچه (مونولیت)، یک تصمیم مقیاسدهی کل برنامه را پوشش میدهد، اما در مایکروسرویسها هر سرویس بودجهی CPU و حافظهی خودش را دارد. چون تیمها معمولاً بهجای تقاضای معمول، برای ترافیک اوج اندازهگذاری میکنند، بیشتر ظرفیت بیکار میماند. ممیزیهای واقعی نشان میدهد میانگین بهرهبرداری اغلب زیر بیست درصد میچرخد و هر ماه دهها هزار دلار بابت کانتینرهای استفادهنشده میسوزد.

شروع اولیه در Serverless

پلتفرمهای Serverless با مقیاسکردن دقیق منابع بر اساس تقاضا و صورتحسابکردن فقط برای مصرف واقعی، وعدهی کارایی هزینه میدهند. اما واقعیت ظریفتر است، بهخاطر «تاخیر شروع سرد»؛ حالتی که وقتی تابع بعد از دورهای بیفعالیتی راهاندازی میشود رخ میدهد و هزینههای پنهان قابلتوجهی ایجاد میکند.

یک تابع AWS Lambda مبتنی بر Java معمولاً تاخیر شروع سردی حدود ۸۰۰ میلیثانیه دارد. با در نظر گرفتن قیمتگذاری AWS Lambda در حدود ۰٫۰۰۰۰۱۶۶۷ دلار به ازای هر میلیثانیه، این تاخیرها سربار هزینهی قابلتوجهی اضافه میکنند. مثلاً یک میلیون فراخوانیِ سرد، فقط از محل تاخیرهای شروع سرد، ۱۳٬۳۳۶ دلار هزینهی اضافه ایجاد میکند. فراتر از پیامدهای مالی، تاخیر شروع سرد مستقیماً تجربه کاربر را تحت تاثیر قرار میدهد. برای نمونه، یک اپلیکیشن فینتک گزارش کرد در جریانهایی که تحت تاثیر شروع سرد بودند، پانزده درصد کاهش در تعامل کاربر رخ داده که مستقیماً با کاهش درآمد و افزایش هزینههای عملیاتی همبستگی داشته است.

بنچمارککردن درست و انتخاب زبانهای برنامهنویسی مناسب یا محیطهای اجرای مناسب میتواند این هزینههای پنهان را بهطور معنیدار کاهش دهد. تحلیل تجربیِ دقیق که در بخشهای بعدی ارائه میشود، این اثرات را در پلتفرمها و زبانهای مختلف کمّی میکند.

منابع یتیم (Orphaned Resources)

وقتی منابع ابر با نامهای روشن برچسبگذاری (Tag) نشوند، فهمیدن اینکه کدام تیم چقدر هزینه میکند سخت میشود. گزارش Alphaus Cloud Management نشان داد سازمانها بهطور متوسط سی درصد از هزینههای ابر خود را هدر میدهند و بخش قابلتوجهی از این مقدار مستقیماً به منابع بدون برچسب نسبت داده میشود.

بنچمارک تجربی: هزینه در برابر عملکرد

برای کمّیکردن اثر انتخاب زبان برنامهنویسی و مدل استقرار بر تاخیر و هزینهی ابر، یک بارکاریِ شبیهسازیشدهی تجارت الکترونیک با نوسانهای ترافیکی واقعگرایانه ساخته شد. این بنچمارک کنترلشده بدهبستانهای هزینه و عملکرد را ایزوله میکند و یک پایهی عینی برای تحلیل FinOps در ادامه فراهم میآورد.

چیدمان آزمایش

برای اندازهگیری بدهبستانهای هزینه و عملکرد تحت شرایط واقعگرایانه، مطالعه از این چیدمان آزمایشی پیروی کرد:

بکاندهای تجارت الکترونیک انتخاب شدند که شامل سه مایکروسرویس برای احراز هویت کاربر، کاتالوگ محصول و قیمتگذاری بودند. هر سرویس با سطح API یکسان طراحی شد اما پروفایل منابع متفاوتی داشت (مثلاً سرویس «قیمتگذاری» CPU-محور بود، در حالی که «کاتالوگ» حافظهمحور بود). سرویسها در سه پیکربندی مستقر شدند:

-

Kubernetes روی AWS EKS (نودهای t3.medium با ۲ vCPU و ۴ گیگابایت RAM)

-

AWS Lambda (سطوح حافظه از ۱۲۸MB تا ۱۰۲۴MB)

-

Azure Functions (پلن Consumption با ۵۱۲MB حافظه)

برای هر سرویس، پیادهسازیهایی در Java (Spring Boot، ۵۱۲MB)، Golang (۲۵۶MB) و Python (۵۱۲MB) ساخته شد و منطق در همه زبانها یکسان نگه داشته شد. الگوهای ترافیک با ترکیبی از درخواستهای کاربر با توزیع پواسون تولید شد (با بار اوج ۵۰۰ درخواست بر ثانیه و خارج از اوج ۵۰ درخواست بر ثانیه) طی ۲۴ ساعت. معیارهای هزینه بر اساس قیمتهای جاری ابر در سهماهه دوم ۲۰۲۵ برآورد شدند. معیارهای عملکرد شامل موارد زیر بود:

-

میانگین زمان پاسخ (ART) در صدک نود و پنجم

-

تاخیر شروع سرد (CSL)، که بهصورت اختلاف زمان بین اولین درخواست و فراخوانیهای گرم بعدی اندازهگیری شد

-

توان عملیاتی (TP) در فازهای ترافیک پایدار و جهشی

-

هزینه ماهانه تخمینی (EMC)، شامل محاسبه، شبکه (خروجی)، و ذخیرهسازی

نتایج هزینه و عملکرد

نتایج پایه Kubernetes/EKS

| سرویس | زبان | میانگین بهرهبرداری CPU (%) | میانگین بهرهبرداری MEM (%) | ART95 (میلیثانیه) | TP (درخواست/ثانیه) | EMC (دلار/ماه) |

|---|---|---|---|---|---|---|

| Auth | Java | ۳۵ | ۴۲ | ۱۲۰ | ۴۵۰ | ۲,۸۰۰ |

| Auth | Go | ۲۷ | ۳۶ | ۹۸ | ۵۰۰ | ۲,۶۰۰ |

| Auth | Python | ۴۱ | ۵۲ | ۱۳۰ | ۵۲۰ | ۲,۹۰۰ |

| Catalog | Java | ۴۸ | ۷۸ | ۱۵۰ | ۳۸۰ | ۳,۱۰۰ |

| Catalog | Go | ۳۹ | ۶۵ | ۱۱۵ | ۴۲۰ | ۲,۹۰۰ |

| Catalog | Python | ۵۲ | ۸۲ | ۱۶۵ | ۳۶۰ | ۳,۲۰۰ |

| Pricing | Java | ۶۲ | ۳۸ | ۱۷۰ | ۳۴۰ | ۳,۳۰۰ |

| Pricing | Go | ۵۱ | ۲۹ | ۱۳۰ | ۳۹۰ | ۳,۰۰۰ |

| Pricing | Python | ۶۷ | ۴۵ | ۱۸۵ | ۳۲۰ | ۳,۴۰۰ |

مشاهدات کلیدی (EKS):

پیادهسازیهای Golang بهطور پیوسته حدود بیستوپنج درصد CPU کمتر و پانزده درصد حافظه کمتر نسبت به همتایان Java/Python تحت بار یکسان مصرف کردند، که به کاهش ده تا پانزده درصدی هزینه ماهانه منجر شد.

سرویسهای مبتنی بر Python بیشترین فشار حافظه را ایجاد کردند و در اوج ترافیک گاهی رویدادهای «بالاآمدن نود» رخ داد که به ازای هر نود-ساعت اضافه، پنج سنت هزینه اضافه کرد.

نتایج AWS Lambda (Serverless)

| سرویس | زبان | حافظه Lambda | میانه شروع سرد (میلیثانیه) | ART95 (میلیثانیه) | TP (درخواست/ثانیه) | EMC (دلار/ماه) |

|---|---|---|---|---|---|---|

| Auth | Java | ۱۰۲۴ MB | ۸۲۰ | ۱۴۵ | ۴۲۰ | ۳,۱۰۰ |

| Auth | Go | ۵۱۲ MB | ۱۵۰ | ۱۱۰ | ۴۸۰ | ۲,۵۰۰ |

| Auth | Python | ۵۱۲ MB | ۲۸۰ | ۱۲۵ | ۴۵۰ | ۲,۷۰۰ |

| Catalog | Java | ۱۰۲۴ MB | ۸۷۰ | ۱۶۰ | ۳۸۰ | ۳,۳۰۰ |

| Catalog | Go | ۵۱۲ MB | ۱۷۰ | ۱۲۰ | ۴۲۰ | ۲,۷۰۰ |

| Catalog | Python | ۵۱۲ MB | ۳۰۰ | ۱۴۰ | ۴۰۰ | ۲,۹۰۰ |

| Pricing | Java | ۱۰۲۴ MB | ۹۱۰ | ۱۷۵ | ۳۵۰ | ۳,۴۰۰ |

| Pricing | Go | ۵۱۲ MB | ۱۸۰ | ۱۳۰ | ۳۹۰ | ۲,۸۰۰ |

| Pricing | Python | ۵۱۲ MB | ۳۲۰ | ۱۵۰ | ۳۷۰ | ۳,۰۰۰ |

مشاهدات کلیدی (Lambda):

توابع Golang بهطور پیوسته با هزینهای حدود پنجاهوپنج درصد کمتر به ازای هر هزار درخواست نسبت به Python یا Java اجرا شدند.

شروع سردِ بیش از ۸۰۰ میلیثانیه در Java به سیزده هزار دلار هزینهی اضافه به ازای هر یک میلیون فراخوانی سرد تبدیل شد و سناریوهای جهشی را بهشدت تحت تاثیر قرار داد.

شروع سردِ حدود ۳۰۰ میلیثانیه در Python برای مسیرهای غیرحساس به تاخیر (مثل کارهای پسزمینه) قابلقبول بود، اما برای جریانهای همگام کاربر، تیمها Go یا «همزمانیِ تدارکدیدهشده» (Provisioned Concurrency) از پیشگرمشده را ترجیح دادند که با نرخ پانزده سنت در ساعت، بخشی از صرفهجویی هزینه را خنثی میکند.

Azure Functions (پلن Consumption)

| سرویس | زبان | حافظه | میانه شروع سرد (میلیثانیه) | ART95 (میلیثانیه) | TP (درخواست/ثانیه) | EMC (دلار/ماه) |

|---|---|---|---|---|---|---|

| Auth | .NET | ۵۱۲ MB | ۲۲۰ | ۱۳۵ | ۴۶۵ | ۲,۹۰۰ |

| Auth | Python | ۵۱۲ MB | ۳۶۰ | ۱۵۰ | ۴۴۰ | ۳,۱۰۰ |

| Catalog | .NET | ۵۱۲ MB | ۲۳۰ | ۱۵۵ | ۴۱۰ | ۳,۰۰۰ |

| Catalog | Python | ۵۱۲ MB | ۳۸۰ | ۱۷۰ | ۳۹۰ | ۳,۲۰۰ |

| Pricing | .NET | ۵۱۲ MB | ۲۵۰ | ۱۶۵ | ۳۸۵ | ۳,۱۰۰ |

| Pricing | Python | ۵۱۲ MB | ۴۰۰ | ۱۸۰ | ۳۷۰ | ۳,۳۰۰ |

مشاهدات کلیدی (Azure):

توابع .NET از بهینهسازیهای شروع سردِ Azure استفاده کردند و به میانهی تاخیر حدود ۲۲۰ میلیثانیه رسیدند که بیست درصد سریعتر از Python بود.

تفاوت هزینهی ماهانه بین زبانها کمتر چشمگیر بود (حدود دویست دلار)، اما زمانهای شروع پایینتر در .NET تجربه کاربر نهایی را در جریانهای همگام بهبود داد.

بهینهسازی هزینه در مراحل مختلف توسعه

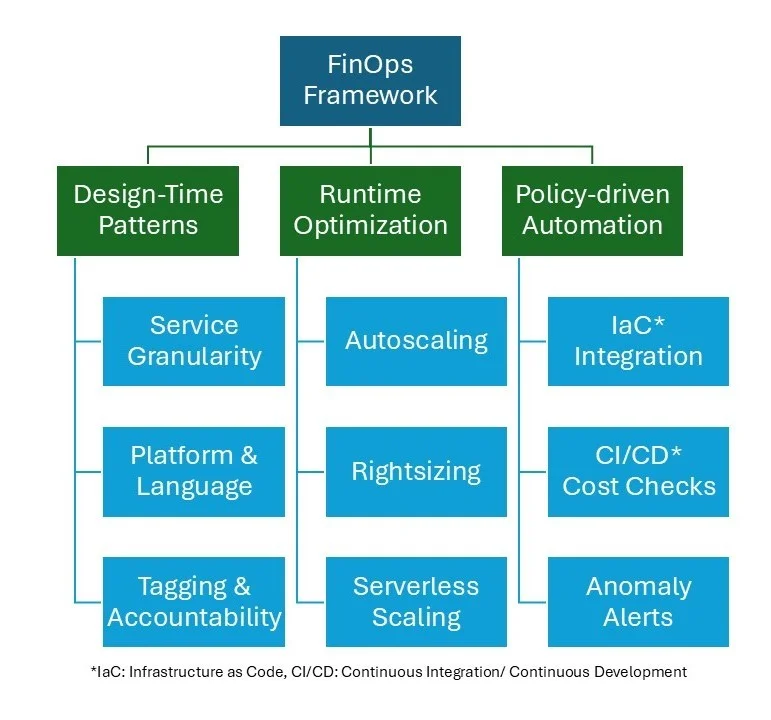

الگوهای FinOps در زمان طراحی

در مرحله طراحی، حیاتی است رفتار هر سرویس را درک کنید تا تخصیص منابع با نیاز واقعی هماهنگ شود و اتلاف رخ ندهد. الگوهای زیر به تیمها کمک میکند معماری را با نیاز بارکاری همراستا کنند و هزینهها را کنترل کنند:

ریزدانگی سرویس و پروفایلسازی منابع

هر مایکروسرویس را بر اساس پروفایل بارکاریاش ارزیابی کنید (مثلاً CPU-محور در برابر حافظهمحور).

پیکربندیهای استقرار و منابع را مطابق نیاز سرویس انتخاب کنید تا هزینه و عملکرد بهینه شود.

الگوهای استفاده را تحلیل کنید تا سرویسهایی با زمان بیکاری بالا شناسایی شوند و مهاجرت آنها به پلتفرمهای Serverless برای کارایی بهتر و صرفهجویی هزینه بررسی شود.

همراستاسازی پلتفرم و زبان

برای بارکارهای جهشی و کوتاهعمر، استفاده از زبانهای کارآمد مثل Golang روی پلتفرمهای Serverless زمان شروع سرد را کمینه میکند و هزینهی هر درخواست را کاهش میدهد.

برای بارکارهای پایدار و پرتراکنش، اجرای سرویسها روی کلاسترهای Kubernetes با مقیاسدهی خودکار، هزینهی زیرساخت را در دورههای کمترافیک بهطور قابلتوجهی کاهش میدهد.

برای اندپوینتهای حساس به تاخیر، استفاده از Provisioned Concurrency یا Runtimeهای بهینهشده تضمین میکند همیشه سریع باشند، حتی اگر برای سرعت تضمینشده کمی هزینه اضافه ایجاد شود.

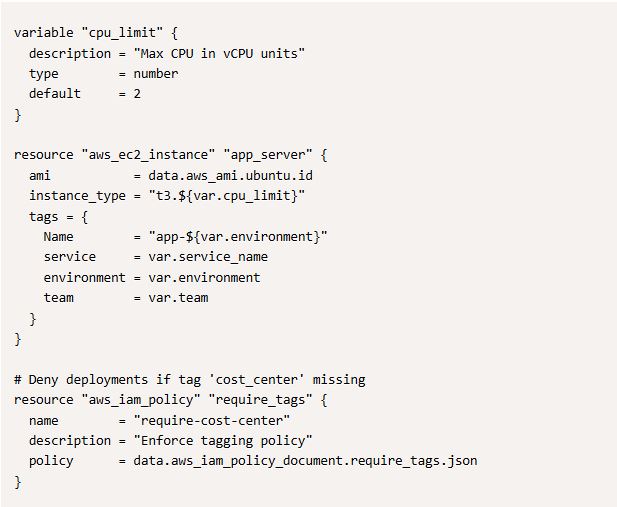

برچسبگذاری، نسبتدهی هزینه و پاسخگویی

یک شِمای برچسبگذاری قدرتمند معمولاً شامل اینهاست:

service:<name> ، environment:<dev|staging|prod> ، team:<owner> و cost_center:<business_unit>.

در عمل، سازمانها میتوانند برچسبگذاری را در سطح سیاستها الزام کنند و هر منبع بدون برچسب را بهصورت خودکار رد کنند. این رویکرد باعث میشود بخش عمدهای از هزینههای ابر بهدرستی به سرویس یا تیم صحیح نسبت داده شود و هزینههای غیرقابلردیابی در مدت کوتاهی بهطور محسوس کاهش یابد. دادن گزارشهای روزانهی دقیق هزینه به تفکیک معیار استفاده، مهندسان را بیشتر تشویق میکند مصرف منابع را بهینه کنند و ناکارآمدیها را رفع کنند.

تکنیکهای بهینهسازی هزینه در زمان اجرا

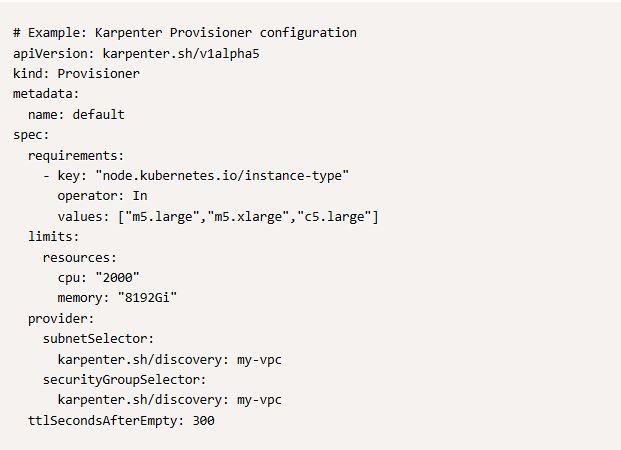

مقیاسدهی خودکار

مدیریت مؤثر منابع در محیطهای Kubernetes نیازمند کنترل دقیق تخصیص نودها برای تطبیق با نیاز بارکاری است. استخرهای نود ثابت (Static) اغلب به ظرفیت استفادهنشده یا کماستفادهی قابلتوجه منجر میشوند و هزینههای زیرساخت غیرضروری ایجاد میکنند.

Karpenter یک مقیاسدهنده خودکار مدرن و پویاست که استخرهای ثابت را با تأمین نود در لحظه بر اساس نیاز واقعی منابع جایگزین میکند. Karpenter اندازههای بهینهی نود و نوع اینستنسها را بهصورت پویا انتخاب میکند و زیرساخت را بهشکل کارآمد با پروفایل بارکاری همراستا میسازد.

یک پیادهسازی اخیر نشان داد ادغام Karpenter ظرفیت استفادهنشده نودها را حدود پنجاهوهفت درصد کاهش داد و کارایی کلی را بهطور چشمگیری بالا برد. علاوه بر این، استفاده از کلاسترهای مجهز به Karpenter، بهویژه در محیطهای غیرتولیدی (مثل توسعه و تست)، برای پایینآوردن تعداد نودها تا صفر در دورههای بیکاری به کار رفت. این راهبرد صرفهجویی هزینهی قابلتوجهی ایجاد کرد و هزینهی ماهانه ابر را بعد از مهاجرت به Karpenter از بازه ۴٬۲۰۰–۴٬۴۰۰ دلار به ۲٬۴۰۰–۲٬۶۰۰ دلار در ماه کاهش داد.

بنابراین، پذیرش راهکارهای مقیاسدهی پویا مانند Karpenter، در کنار راهبردهای Kubernetes Cluster Autoscaler، استفاده از زیرساخت و کارایی هزینه را بهطور جدی بهینه میکند و با بهترینروشهای FinOps همراستا است.

Horizontal Pod Autoscaler (HPA) + Vertical Pod Autoscaler (VPA)

این ترکیب امکان بهینهسازی دقیق و خودکار منابع را در محیطهای Kubernetes فراهم میکند. نتایج تجربی از تنظیم آستانههای HPA کاهش معناداری در مصرف منابع را نشان داد: بهطور مشخص، دوازده سرویس تولیدیِ پایششده کاهش استفاده CPU در صدک نود و پنجم را از هفتاد درصد به چهلوپنج درصد تجربه کردند. در نتیجه، پیکربندی بهینهشدهی مقیاسدهی خودکار اجازه داد حداقل تعداد Replicaهای Pod در دورههای کمتقاضا از سه به یک کاهش یابد و بیشتأمین منابع و هزینههای عملیاتی وابسته به آن کمینه شود.

مقیاسدهی خودکار Serverless: Provisioned Concurrency در AWS Lambda

Provisioned Concurrency در AWS Lambda با پیشراهاندازی محیطهای اجرا، کمترین تاخیر را برای توابع حیاتی تضمین میکند و بهطور پایدار به عملکرد شروع سرد ۱۰۰ میلیثانیه میرسد. مشاهدات تجربی نشان میدهد نگهداشتن پنج نمونه Provisioned Concurrency حدوداً ۵۴ دلار در ماه به ازای هر تابع هزینه دارد، با نرخ ساعتی پانزده سنت. با این حال، این سرمایهگذاری از نظر اقتصادی توجیهپذیر است، چون اپلیکیشنهای حساس به تاخیر با این پیکربندی از زیان ماهانهی برآوردی حدود سه هزار دلار که ناشی از ریزش کاربر به دلیل تاخیرهای بالای شروع سرد بود جلوگیری کردند. بنابراین استفاده راهبردی از Provisioned Concurrency توازن مؤثری بین نیازهای عملکرد و ملاحظات هزینه ایجاد میکند و با بهترینروشهای FinOps همراستا است.

سایزبندی درست (Rightsizing)

Compute Optimizer و GCP Recommender

این ابزارهای خودکارِ درستسایزکردن منابع کماستفاده را بهصورت نظاممند شناسایی میکنند. با عملیاتیکردن این بینشها از طریق اسکریپتهای هفتگی که پیشنهادها را دریافت و اجرا میکنند، سازمانها میتوانند بهطور پیشدستانه اینستنسهای کمبازده را خاموش کنند یا تغییر اندازه دهند. تحلیل تجربی یک پیادهسازی نشان داد در یک فصل، خاتمهدادن یا تغییر اندازهی چهلوپنج اینستنس ابری انجام شد و صرفهجویی هزینهای حدود دوازده هزار دلار ایجاد کرد.

Cron Jobهای سفارشی

علاوه بر این، اتوماسیون سفارشی از طریق کارهای زمانبندیشده مثل Cron jobهای مبتنی بر Python، بهینهسازی پیوسته را در سطح Podهای Kubernetes ممکن میکند. برای مثال، یک اسکریپت شبانه Python پیشنهادهای ارائهشده توسط HPA و VPA را تحلیل کرد و بهصورت خودکار درخواستهای منابع را برای بیستوهفت سرویس Kubernetes تنظیم کرد. این بهینهسازی هدفمند طی یک دوره ارزیابی دوماهه، معیار «درخواست بر ثانیه به ازای هر دلار» را هجده درصد بهبود داد و ارزش مدیریت خودکار و ریزدانهی منابع همراستا با اصول FinOps را برجسته کرد.

پیادهسازیهای بینابری

بسیاری از تیمها بارکارها را روی AWS، Azure و ابرهای دیگر اجرا میکنند که هزینههای اضافی برای انتقال داده بین ابرها ایجاد میکند (برای مثال AWS حدود نه سنت به ازای هر گیگابایت برای انتقال دادهی خروجی به DigitalOcean دریافت میکند). برای کاهش این هزینهها، سرویسهای «پرحرف» (ارتباطات زیاد) را در یک منطقه قرار دهید یا از Peering/CDNها استفاده کنید، و یک چارچوب برچسبگذاری یکپارچه را در همه ارائهدهندگان اعمال کنید تا یک نمای واحد و شفاف از هزینههای ابر داشته باشید.

اتوماسیون FinOps مبتنی بر سیاست

ادغام Infrastructure-as-Code

ادغام مدیریت هزینه بهطور مستقیم در چارچوبهای Infrastructure-as-Code (IaC) مثل Terraform، مسئولیتپذیری مالی را در مرحله تأمین منابع الزامآور میکند. با تعریف صریح محدودیتهای منابع و برچسبگذاری اجباری، تیمها میتوانند پیشاپیش هزینههای یتیم را کاهش دهند. برای نمونه، جاسازی محدودیتهای مرتبط با هزینه، مثل سقف CPU، در ماژولهای Terraform کنترل ریزدانهای بر تخصیص منابع ایجاد میکند:

با اجرای سیاستها از طریق IAM، تلاشهای تأمین منابع که برچسبهای حیاتی نسبتدهی هزینه مثل «cost_center» را حذف کردهاند بهصورت نظاممند رد میشوند. این راهبرد حکمرانیِ پیشدستانه بهطور معنیدار هزینههای یتیم را کاهش میدهد، چون تضمین میکند همه منابع از همان ابتدا پاسخگویی مالی روشن داشته باشند و مدیریت زیرساخت با بهترینروشهای FinOps همراستا شود.

بررسیهای هزینه در CI/CD

ادغام Infracost

ادغام آگاهی از هزینه در پایپلاینهای CI/CD مدیریت پیشدستانه هزینههای ابر را در سراسر چرخه توسعه تضمین میکند. ابزارهایی مثل Infracost محاسبهی هزینههای افزایشی ابر را که از تغییرات کد ایجاد میشود خودکار میکنند. شواهد تجربی از یک پیادهسازی نشان داد در یک فصل، ارزیابیهای خودکار Infracost چهلودو Pull Request را شناسایی کرد که از آستانه اثر هزینهی پانصد دلار عبور کرده بودند. این شناسایی زودهنگام به توسعهدهندگان اجازه داد پیش از استقرار، کدهای بالقوه پرهزینه را بازطراحی کنند و خطر هزینههای عملیاتی غیرمنتظره را بهطور قابلتوجهی کاهش دهند.

آزمونهای پیش از ادغام (Pre-Merge)

چارچوبهای آزمون پیش از ادغام مبتنی بر هزینه، احتیاط مالی را با شبیهسازی سناریوهای بار اوج قبل از ادغام کد تقویت میکنند. آزمونهای خودکار معیارهای کلیدی از جمله زمان پاسخ در صدک نود و پنجم و هزینه تخمینی به ازای ده هزار درخواست را اندازهگیری کردند تا انطباق با بنچمارکهای مالی-عملکردی تعیینشده حفظ شود. Pull Requestهایی که معیارهای از پیش تعریفشدهی کارایی هزینه را رعایت نمیکردند (مثلاً عبور از آستانه پنجاه سنت به ازای ده هزار درخواست) بهصورت نظاممند مسدود شدند. این روش نهتنها از رسیدن پسرفتهای هزینه به محیط تولید جلوگیری کرد، بلکه فرهنگ توسعهی سختگیرانه و هزینهآگاه را مطابق بهترینروشهای FinOps ترویج داد.

تشخیص ناهنجاری و هشدارها

CloudWatch + PagerDuty

سازوکارهای مؤثر تشخیص ناهنجاری و هشدار، عناصر حیاتی در مدیریت پیشدستانه هزینههای ابر هستند، بهویژه وقتی با اهداف سطح سرویس (SLO) روشن یکپارچه شوند. با استفاده از پلتفرمهای پایش مثل Amazon CloudWatch و PagerDuty، سازمانها هشدارهای خودکاری تنظیم میکنند که وقتی آستانههای مالی یا عملکردی از SLOهای تعریفشده منحرف شوند فعال میشوند. نمونههای عملی شامل اعلان برای شرایطی مثل عبور هزینه روزانه AWS Lambda از هزار دلار یا پایینماندن پایدار بهرهبرداری CPU زیر بیست درصد طی شش ساعت در کلاسترهای Amazon EKS است. این تریگرهای خودکار نهتنها اقدامات فوری برای کوچکسازی منابع و بررسی هزینه را آغاز میکنند، بلکه انطباق با SLOهای عملکردی و مالی را هم تضمین میکنند.

Datadog Cost Dashboards

ابزارهای جامع مشاهدهپذیری هزینه مثل Datadog Cost Dashboards معیارهای صورتحساب را با دادههای پایش عملکرد برنامه (APM) ترکیب میکنند و مستقیماً از انطباق با SLOهای عملیاتی و هزینهای پشتیبانی میکنند. برای مثال، یک سازمان از طریق یک ناهنجاری هزینه مبتنی بر SLO کشف کرد یک مایکروسرویس Java بهصورت ناخواسته تخصیص حافظه را از ۵۱۲MB به ۱۵۳۶MB افزایش داده و هزینهی افزایشی برنامهریزینشدهای حدود ۷٬۵۰۰ دلار در ماه ایجاد کرده است. هرچند ابزارهایی مثل Datadog و New Relic هزینههای اشتراک و مصرف دارند که میتواند قابلتوجه باشد، اما اغلب با امکان شناسایی و اصلاح سریع ناهنجاریهای هزینه، سرمایهگذاری را توجیه میکنند. این موضوع اهمیت بهکارگیری FinOps برای مدیریت هزینههای مربوط به زیرساخت و ابزارهای مشاهدهپذیری را برجسته میکند.

FinOps چندابری

علاوه بر دغدغههای عملکردی داخل یک ابر، هزینههای خروجی (Egress) برای سرویسهای «پرحرف» (فراخوانیهای API پرتعداد، ارتباطات مایکروسرویسی، یا جریانهای استریمینگ) که بین ارائهدهندگان ابر (مثل AWS، GCP و Azure) کار میکنند اغلب نادیده گرفته میشود. برای روشنشدن موضوع، انتقال فقط ۵۰ ترابایت داده در ماه از AWS به GCP (حدود نه سنت به ازای هر گیگابایت) میتواند پس از ۱۰۰ گیگابایت رایگانِ اول، فقط بابت ترافیک خروجی حدود ۴٬۰۵۰ دلار در ماه هزینه ایجاد کند. طراحی برای هممکانی سرویسهای بهشدت وابسته در یک ابر، برچسبگذاری خروجی بینابری برای نسبتدادن به تیمهای مشخص، استفاده از ابزارهای متمرکز FinOps که مدلهای صورتحساب متفاوت را بین ارائهدهندگان یکسانسازی میکنند، یا ابزارهایی مانند Apptio Cloudability، Kubecost یا Finout برای آشکارکردن ناهنجاریهای هزینه مبتنی بر ترافیک، از روشهای پیادهسازی یک چارچوب FinOps چندابری هستند.

جمعبندی پایانی

بنچمارککردن بارکارهای واقعگرایانه

همیشه هزینه و عملکرد را تحت بار شبیه تولید اندازهگیری کنید. برای مثال، جهشهای «حراج تعطیلات» را آزمایش کنید که میتواند چهار برابر ترافیک معمول باشد. این کار اغلب ناکارآمدیهای پنهان مقیاسدهی خودکار یا نقاط داغ شروع سرد را آشکار میکند.

همراستا کردن زبان با پلتفرم

AWS Lambda: Golang هم در شروع سرد و هم در هزینه به ازای هر یک میلیون درخواست از Java/Python بهتر عمل میکند.

Azure Functions: .NET کمترین زمان شروع سرد را نشان میدهد (حدود ۲۲۰ میلیثانیه) و هشت تا ده درصد کارمزد ماهانه کمتر نسبت به Python دارد.

اجرای برچسبگذاری اجباری در IaC

الزام برچسبگذاری را در Terraform/CloudFormation جاسازی کنید. هر استقراری که استانداردهای برچسبگذاری را رعایت نکند رد کنید. این کار از منابع یتیم جلوگیری میکند و پاسخگویی ایجاد میکند.

اتوماسیون بررسی هزینه در CI/CD

Infracost یا ابزارهای مشابه را در Pull Requestها یکپارچه کنید و یک «گاردریل هزینه» بسازید. اگر تغییری بیش از صد دلار هزینه ماهانه اضافه میکند، تأیید صریح یک مسئول FinOps را لازم کنید.

پایش و تنظیم پیوسته مقیاسدهی خودکار

آستانههای Kubernetes HPA/VPA را تنظیم کنید تا بهرهبرداری نودها بالای شصت درصد اما زیر هشتاد و پنج درصد بماند تا مشکلات همسایه پرسر و صدا رخ ندهد.

Provisioned Concurrency در Serverless را برای مسیرهای پرترافیک ارزیابی کنید تا در برابر پانزده سنت در ساعت برای هر واحد تدارکدیدهشده، زمانهای شروع قابلپیشبینی زیر ۱۰۰ میلیثانیه داشته باشید.

گروهبندی سرویسهای کمفعالتر، پراکندگی و هزینه بیکاری را کاهش میدهد.

بهجای استخرهای نود ثابت، از تأمین پویا (Karpenter، مقیاسدادن تا صفر) استفاده کنید. از مقیاسدهی خودکار و معیارهای دقیق بهره بگیرید تا منابع با تقاضا منطبق شوند.

تقویت همکاری میانوظیفهای

همگامسازیهای دو هفته یکبار FinOps بین مهندسی، DevOps و مالی برنامهریزی کنید.

داشبوردهای هزینه را در کانالهای تیمی به اشتراک بگذارید، دستاوردهای صرفهجویی ماهانه را جشن بگیرید و ناهنجاریها را زود آشکار کنید.

مطالعات موردی: FinOps در عمل

Slack: تقویت FinOps در Kubernetes با مقیاسدهی خودکار پویا

Slack با پذیرش Karpenter، یک ابزار تأمین پویای نود برای کلاسترهای Kubernetes، کارایی منابع و مدیریت هزینه را بهبود داد. با گذار از استخرهای نود ثابت به تخصیص درلحظهی اینستنسهای EC2 بر اساس تقاضا، Slack بهرهبرداری کلاستر را بالا برد و اتلاف منابع بیکار را بهطور چشمگیری کاهش داد. علاوه بر این، Slack ابزارهای پایش هزینهی لحظهای را در کنار SLOهای روشن ادغام کرد و پاسخگویی توسعهدهندگان و همراستایی فرهنگی ایجاد کرد تا کارایی هزینه همردیف با قابلیت اطمینان و امنیت سیستم قرار بگیرد. این رویکرد ساختیافته، احتیاط مالی را بهعنوان یک انضباط هستهای مهندسی در الگوی عملیاتی Slack تثبیت کرد.

Capital One: پیادهسازی حکمرانی FinOps در یک نهاد مالی قانونمند

Capital One یک تیم اختصاصی Cloud Finance (FinOps) تشکیل داد که مسئول اجرای حکمرانی سختگیرانه هزینه و پاسخگویی مالی در سراسر زیرساخت ابری بود. با عملیاتیکردن سیاستهای خودکار برای خاموشسازی زمانبندیشده منابع، الزام برچسبگذاری سختگیرانه، و اعمال کنترلهای جامع بودجه، Capital One به نظارت مالی دقیق همراستا با الزامات انطباقی دست یافت. علاوه بر این، تیم FinOps بر اقتصاد واحدها تمرکز ویژه داشت؛ یعنی تحلیل «هزینه به ازای هر تراکنش» که هزینههای ابر را به نتایج ملموس کسبوکار پیوند میداد. گزارشدهی خودکار لحظهای و ابزارهای بصریسازی داخلی، بینشهای بهموقع در اختیار تیمهای مهندسی گذاشت و تصمیمگیری آگاهانه و کسبوکارمحور را تقویت کرد تا هزینههای ابر بهصورت نظاممند بهینه شوند.

ابزارها و پلتفرمها برای مدیریت هزینه ابر

مجموعههای ارائهدهندگان ابر

AWS Cost Explorer، Azure Cost Management، GCP Billing/BigQuery، AWS Budgets، Compute Optimizer، Azure Advisor، GCP Recommender.

ابزارهای هزینه Kubernetes

OpenCost، Kubecost، CloudZero، VMware Aria Cost.

مشاهدهپذیری و APM

Prometheus، Datadog، New Relic، Dynatrace، Grafana.

اتوماسیون و APIهای صورتحساب

AWS Cost Explorer API، Azure Consumption API، GCP Billing API، Open Policy Agent (OPA) برای اجرای سیاستها.

نتیجهگیری

Backend FinOps فراتر از مدیریت سنتی هزینه میرود و پاسخگویی مالی را در هر لایه از مهندسی مایکروسرویسها جاسازی میکند. با طراحی دقیق در انتخاب زبانهای مناسب، مدلهای استقرار، و اندازهگذاری منابع، تیمها میتوانند بین عملکرد و هزینه توازن برقرار کنند. بهینهسازیهای زمان اجرا، اتوماسیون سیاستها، و فرهنگ بازخورد پیوسته تضمین میکند صرفهجوییها با تکامل سیستمها پایدار بمانند. با رشد مقیاس و پیچیدگی محیطهای بومی ابر، ادغام FinOps در چرخه عمر توسعه اختیاری نیست. برای نوآوری پایدار ضروری است!